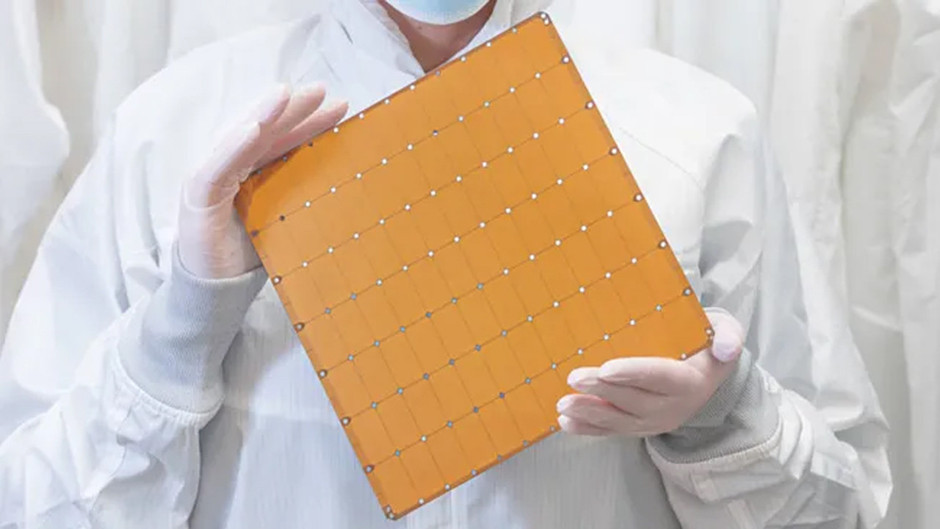

Kaliforniya Üniversitesi'neden mühendisler, yapay zeka donanımında hem performansı hem de enerji verimliliğini artırmayı hedefleyen alternatif bir yaklaşım üzerinde çalışıyor. Araştırma ekibi, geleneksel grafik işlem birimleri (GPU) yerine, çok daha büyük ve tek parça olarak tasarlanan "wafer-scale" çiplerin potansiyelini inceliyor.

Bu yaklaşım, akademik Device dergisinde yayımlanan bir makalede detaylandırıldı. Çalışmanın başyazarı olan elektrik ve bilgisayar mühendisliği profesörü Mihri Özkan, bu tür büyük ölçekli çiplerin, yapay zeka modellerini daha hızlı ve daha verimli şekilde çalıştırabileceğini vurguluyor. Özellikle trilyonlarca parametreye sahip günümüz yapay zeka sistemleri için geleneksel çip mimarilerinin sınırlı kaldığına dikkat çekiliyor.

Wafer-scale sistemler, geleneksel GPU mimarisinde olduğu gibi çok sayıda küçük çipin bir arada çalışmasına ihtiyaç duymuyor. Tüm işlem birimleri tek bir silikon plaka üzerinde birleştiği için, veri transferi sırasında oluşan enerji kaybı ve gecikmeler önemli ölçüde azalıyor.

Bu teknolojiye dair en bilinen örneklerden biri olan Cerebras’ın Wafer-Scale Engine 3 (WSE-3) modeli, tam 4 trilyon transistör ve yaklaşık 900.000 özel yapay zeka çekirdeği içeriyor. Buna karşılık, Tesla’nın Dojo D1 işlemcisi 1,25 trilyon transistör ve yaklaşık 9.000 çekirdek ile daha küçük bir ölçekte benzer bir yaklaşımı sürdürüyor. Her iki örnek de enerji verimliliği ve hesaplama kapasitesi açısından geleneksel GPU’lara göre önemli avantajlar sunuyor.

Daha az enerji, daha az israf

Yapay zeka modelleri büyüdükçe, onları çalıştırmak için harcanan enerji miktarı da giderek artıyor. Özkan, bu nedenle wafer-scale çiplerin sadece performans değil, çevresel etki açısından da öne çıktığını belirtiyor. WSE-3 örneğinde, geleneksel GPU sistemlerine kıyasla çok daha düşük enerjiyle saniyede 125 katrilyon işlem yapılabiliyor.

Profesör Özkan, bu farkı şöyle örneklendiriyor: “GPU’lar, yoğun saatlerde sıkışan otobanlara benziyor. İşlevsel ama trafik nedeniyle enerji boşa gidiyor. Wafer-scale çipler ise raylı sistemler gibi, doğrudan ve verimli çalışıyor.”

Ancak bu büyük ölçekli çiplerin çözülmeyi bekleyen önemli bir teknik sorunu da var: Isı yönetimi. Wafer-scale çipler, çalışırken 10.000 watt’a kadar enerji tüketebiliyor ve bu enerjinin büyük kısmı ısıya dönüşüyor. Bu nedenle, performansı koruyabilmek için sofistike soğutma sistemlerine ihtiyaç duyuluyor.

Farklı üreticiler bu soruna farklı çözümler geliştirmiş durumda. Cerebras, çip içine entegre ettiği glikol bazlı bir soğutma döngüsü kullanırken, Tesla, çip yüzeyine eşit biçimde yayılan sıvı soğutma yöntemini tercih ediyor.

Wafer-scale çipler, yapay zekanın giderek büyüyen hesaplama ihtiyacına çözüm sunarken, beraberinde yeni teknik ve mühendislik zorlukları da getiriyor. Geleneksel GPU’lar düşük maliyetli, modüler yapılarıyla halen cazibesini korurken, bu yeni yaklaşım hem enerji verimliliği hem de ölçeklenebilirlik açısından dikkatle takip ediliyor. Önümüzdeki dönemde, yapay zeka donanımının geleceğini şekillendirecek en önemli kararlardan biri, bu büyük ölçekli çiplerin ne kadar yaygınlaşabileceği olacak.